Cover Story

ഒറിജിനല് വ്യാജന്

2017ലാണ് സംഭവം. യു എസ് മുൻ പ്രസിഡന്റ് ബരാക് ഒബാമയുടെ ആ വീഡിയോ കണ്ട് ലോകം ഞെട്ടി. അമേരിക്കൻ പ്രസിഡന്റുമാരുടെ കൂട്ടത്തിൽ പൊതുവെ മാന്യനെന്ന് വിലയിരുത്തപ്പെടുന്ന ഒബാമ തന്റെ പിൻഗാമി ഡൊണാൾഡ് ട്രംപിനെ അശ്ലീലം പറയുന്നു.

വിശ്വസിക്കാനാകാതെ പലരും ആവർത്തിച്ചുകണ്ടു. അതെ, വീഡിയോയിലുള്ളത് ഒബാമ തന്നെ. പിന്നീട് അരക്കോടിയിലധികം ആൾക്കാരിലേക്ക് ആ വീഡിയോ പ്രകാശ വേഗതയിൽ സഞ്ചരിച്ചു. പക്ഷേ, യാഥാർഥ്യം അതായിരുന്നില്ല. വീഡിയോയിൽ കണ്ടത് സാക്ഷാൽ ഒബാമയെ അല്ല; മറിച്ച് ഒബാമയുടെ കൃത്രിമ ദൃശ്യങ്ങളായിരുന്നു അത്. എന്നാൽ കൃത്രിമമാണെന്ന് കാണുന്ന ഒരാൾക്ക് പോലും തോന്നില്ല. അത്രയും “ഒറിജിനാലിറ്റി”യുണ്ടായിരുന്നു ആ ദൃശ്യങ്ങൾക്ക്. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് (എ ഐ) അഥവാ നിർമിത ബുദ്ധിയെന്ന സാങ്കേതിക മുന്നേറ്റത്തിന്റെ സൃഷ്ടിയായ “ഡീപ്ഫെയ്ക്” എന്ന അപകടകാരിയായ സംവിധാനമാണ് ഇതിനായി ഉപയോഗിച്ചത്. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ അപകട സാധ്യത വരച്ചുകാട്ടാൻ വാഷിംഗ്ടൺ യൂനിവേഴ്സിറ്റിയിലെ വിദഗ്ധരാണ് വീഡിയോ തയ്യാറാക്കിയത്.

മനുഷ്യ ബുദ്ധി ചെയ്യുന്നതെല്ലാം

21ാം നൂറ്റാണ്ടിലെ ഏറ്റവും വലിയ സാങ്കേതിക വിപ്ലവമാണ് ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ്. മനുഷ്യൻ ചെയ്യുന്ന ബുദ്ധിപരമായ എല്ലാ പ്രവർത്തനങ്ങളും കമ്പ്യൂട്ടർ സിസ്റ്റത്തെ കൊണ്ടു ചെയ്യിപ്പിക്കുന്ന സാങ്കേതികതയാണ് എ ഐ എന്ന് ചുരുക്കിപ്പറയാം. നിത്യജീവിതത്തിന്റെ പല കോണുകളിലും ഈ സാങ്കേതിക വിദ്യയുടെ ഉപയോഗം വർധിച്ചുവരികയാണ്. 2035ഓടെ നിർമിത ബുദ്ധി വഴി 40 ശതമാനം വരെ ഉത്പാദനം സാധ്യമാകുമെന്നാണ് പഠനത്തിൽ വ്യക്തമാകുന്നത്. ആഗോളവിപണിയിൽ 36 ശതമാനം നിരക്കിലാണ് ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ വളർച്ച. 2025ൽ മൂന്ന് ലക്ഷം കോടി ഡോളറാകും ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ വിപണി മൂല്യമെന്നും സാങ്കേതിക വിദഗ്ധർ ചൂണ്ടിക്കാട്ടുന്നു. ഗൂഗിൾ, ഐ ബി എം, ആപ്പിൾ, ഫേസ്ബുക്, മൈക്രാസോഫ്റ്റ് തുടങ്ങിയ സാങ്കേതിക ഭീമന്മാർ ഈ മേഖലയിൽ വൻ പരീക്ഷണങ്ങൾ നടത്തുന്നുണ്ട്. സഊദി അറേബ്യ പൗരത്വം നൽകിയ സോഫിയ എന്ന ഹ്യൂമനോയിഡ് റോബോട്ട് മുതൽ കേരള പോലീസ് ആസ്ഥാനത്ത് ജനങ്ങളെ സ്വീകരിക്കുന്ന കെ പി- ബോട്ട് വരെ ഈ സാങ്കേതികവിദ്യയുടെ സൃഷ്ടിയാണ്.

ഒരു ഭാഗത്ത് ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് വിപ്ലവം സൃഷ്ടിക്കുമ്പോൾ മറുഭാഗത്ത് അണുബോംബിനോളം വിനാശകരമായ സാഹചര്യവും അത് ഒരുക്കിവെക്കുന്നുണ്ട്. മനുഷ്യത്വത്തിന് ഏറ്റവും നല്ലതോ മോശമായതോ ആയ ഒന്നായിരിക്കും ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് എന്നാണ് ലോകപ്രശസ്ത ഭൗമശാസ്ത്രജ്ഞനായിരുന്ന സ്റ്റീഫൻ ഹോക്കിംഗ്സ് വിശേഷിപ്പിച്ചത്. ആണവോർജത്തേക്കാൾ അപകടകരമാണ് എ ഐ എന്ന് എലൻ മസ്കിന്റെ വാക്കുകളും ഇതിന്റെ ഗൗരവം വരഞ്ഞുകാട്ടുന്നു. അത്തരത്തിലൊരു അപകടമാണ് എ ഐയുടെ ഉപോത്പന്നമായ ഡീപ് ഫെയ്ക്.

മോർഫിംഗ് പഴഞ്ചൻ

സാങ്കേതികവിദ്യയുടെ പ്രാരംഭകാലം മുതൽ തന്നെ ദുരുപയോഗവും ആരംഭിച്ചിട്ടുണ്ട്. ഇതിന്റെ ഉദാഹരണങ്ങളിൽ ഒന്ന് മാത്രമാണ് മോർഫിംഗ്. ഫോട്ടോഷോപ്പ്, എയർബ്രഷ് പോലുള്ള സങ്കേതങ്ങൾ ഉപയോഗിച്ച് ചിത്രങ്ങളിൽ കൃത്രിമം കാണിക്കുന്ന മോർഫിംഗിന് ഇരകളാക്കപ്പെട്ടവർ നിരവധിയാണ്. മോർഫ് ചെയ്ത ചിത്രം പ്രചരിപ്പിക്കപ്പെട്ടതിന്റെ പേരിൽ ജീവനൊടുക്കേണ്ടി വന്നവരും ഏറെയുണ്ട്. എന്നാൽ നിശ്ചലദൃശ്യങ്ങളിലായിരുന്നു ഈ വിദ്യ പ്രയോഗിക്കപ്പെട്ടിരുന്നതെങ്കിൽ ഇന്നത് വീഡിയോയിലേക്കും പടർന്നുകഴിഞ്ഞുവെന്നതാണ് ഞെട്ടിപ്പിക്കുന്ന വസ്തുത. ഒറിജിനലിനെ വെല്ലുന്ന മികവോടെ ഒരാളുടെ വീഡിയോ ചിത്രവും ശബ്ദവും അനുകരണങ്ങളും വരെ തയ്യാറാക്കാൻ സാധിക്കുന്ന ആപ്പുകൾ നെറ്റ്ലോകത്ത് സുലഭമായിക്കഴിഞ്ഞു. അതാണ് ഡീപ്ഫെയ്ക്.

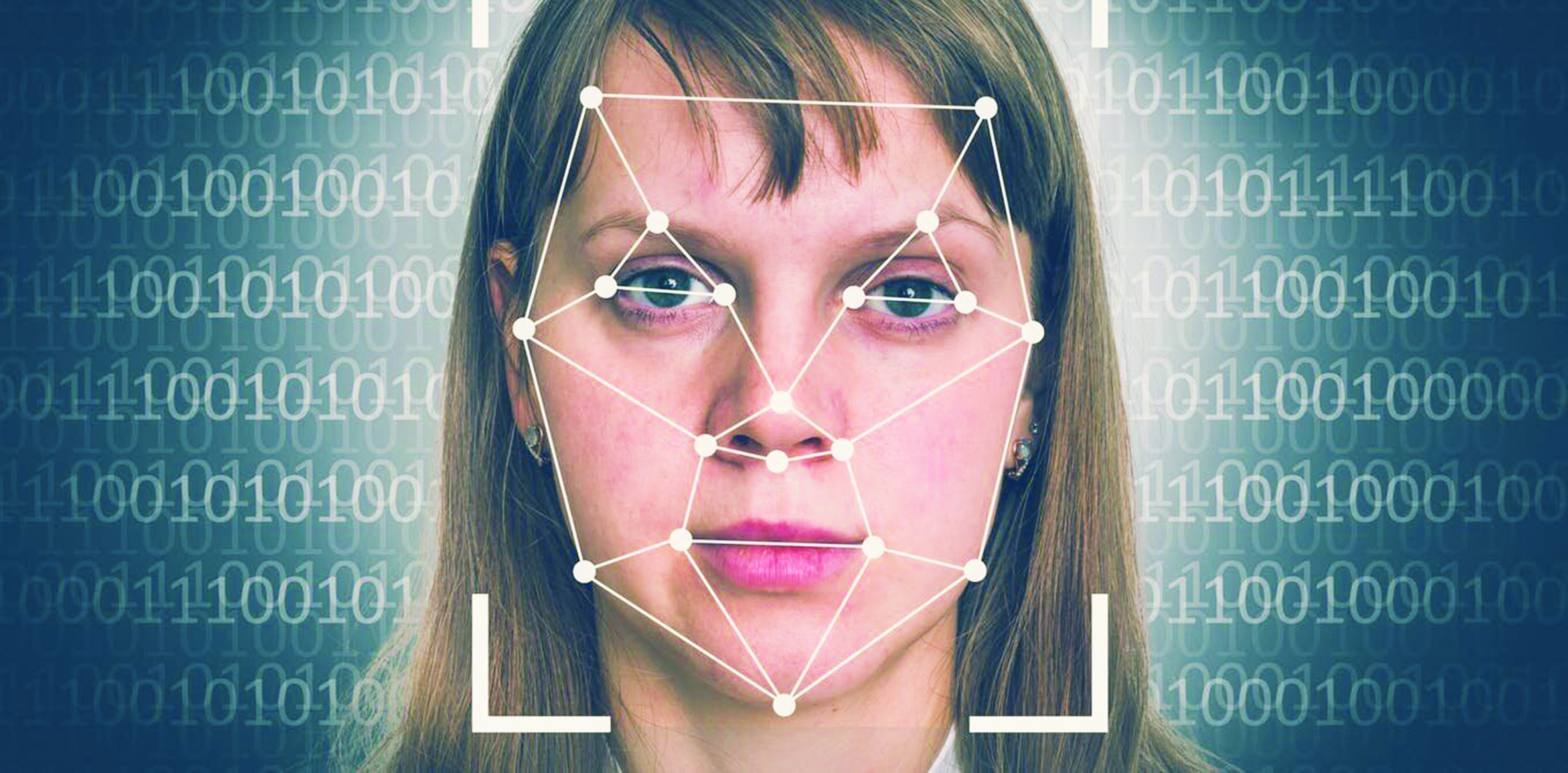

മെഷീൻ ലേണിംഗ് അൽഗോരിതങ്ങൾ ഉപയോഗിച്ച്, യഥാർഥത്തിലുള്ള ഒരു വീഡിയോ ക്ലിപ്പിനുമേൽ ചില മാറ്റങ്ങൾ വരുത്തി സൃഷ്ടിക്കുന്നവയാണ് ഡീപ്ഫെയ്ക് വീഡിയോകൾ. സ്റ്റാൻഫെഡ് യൂനിവേഴ്സിറ്റിയിലെ ശാസ്ത്രജ്ഞരാണ് ആദ്യമായി ഡീപ്ഫെയ്ക്ക് വീഡിയോ തയ്യാറാക്കിയത്. വീഡിയോ ദൃശ്യത്തിൽ സംസാരിക്കുന്ന ഒരാളുടെ മുഖത്തുണ്ടാകുന്ന ഭാവഭേദങ്ങളും പേശികളുടെ ചലനങ്ങളും എല്ലാം ഒപ്പിയെടുത്ത് മറ്റൊരു വീഡിയോയിൽ ചേർത്താണ് വ്യാജ വീഡിയോ നിർമിക്കുന്നത്. ഒരാൾ തല ചെരിക്കുന്നതും ചുണ്ടനക്കുന്നതും കണ്ണുചിമ്മി തുറക്കുന്നതുമെല്ലാം തികച്ചും സ്വാഭാവികമായി പകർത്തിയെടുക്കാനാകും. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ ശാഖയായ അഡ്വേർസേറിയൽ ന്യൂറൽ നെറ്റ്വർക്കിന്റെ സഹായത്തോടെയാണ് ഇത് ചെയ്യുന്നത്. ന്യൂറൽ നെറ്റ്വർക്കുകൾ ഒരാളുടെ മുഖത്തെ വിവിധ പോയിന്റുകളെ മനസ്സിലാക്കുകയും അവയെ ഗണിതശാസ്ത്രപരമായി പഠിക്കുകയും അതിനു ശേഷം ഒരാളുടെ മുഖത്തിനു മുകളിലായി മറ്റൊരാളുടെ മുഖം കൊണ്ടുവരികയുമാണ് ചെയ്യുന്നത്. മനുഷ്യന് പകരം കമ്പ്യൂട്ടർ സിസ്റ്റമാണ് ഇതെല്ലാം ചെയ്യുന്നത് എന്നതിനാൽ ഒറിജിനൽ ഏത് വ്യാജനേത് എന്ന് കണ്ടുപിടിക്കുക പോലും അസാധ്യമാകും. ഹോളിവുഡ് താരങ്ങളായ ജെനിഫർ ലോറൻസ്, ടെയ്ലർ സ്വിഫ്റ്റ,് ഹാരി രാജകുമാരന്റെ കാമുകി മേഗൻ മർക്കൽ തുടങ്ങിയവരെല്ലാം ആഗോളതലത്തിൽ ഡീപ്ഫെയ്ക്കിന് ഇരകളായിട്ടുണ്ട്. ഇതോടെ, ഡീപ്ഫെയ്ക് വീഡിയോകൾ പ്രസിദ്ധീകരിക്കില്ലെന്നും ഇവ അപ്ലോഡ് ചെയ്യുന്നവർക്ക് എതിരെ കർശന നടപടി എടുക്കുമെന്നും റെഡിറ്റും ട്വിറ്ററുമെല്ലാം വ്യക്തമാക്കിയിട്ടുണ്ട്.

വ്യാജവാർത്തകൾക്ക്

പുതിയ മാനം

ഇന്ന് ഇന്റർനെറ്റ് ലോകം അനുഭവിക്കുന്ന വലിയൊരു പ്രതിസന്ധിയാണ് വ്യാജവാർത്തകളുടെ കുത്തൊഴുക്ക്. സമൂഹമാധ്യമങ്ങളുടെ കടന്നുവരവോടെ ആർക്കും എന്തും പ്രചരിപ്പിക്കാമെന്നതാണ് സ്ഥിതി. ഇതിനിടയിലേക്കാണ് ഡീപ്ഫെയ്കുകളുടെ രംഗപ്രവേശം. ഇന്ത്യൻ രാഷ്ട്രീയവുമായി ബന്ധപ്പെട്ട ഒരാൾ ഡീപ് ഫെയ്ക് വീഡിയോകൾ തയ്യാറാക്കാൻ ആവശ്യപ്പെട്ട് ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് എൻജിനീയറെ സമീപിച്ചുവെന്ന് അടുത്തിടെയാണ് റിപ്പോർട്ടുകൾ പുറത്തുവന്നത്. കർണാടക നിയമസഭാ തിരഞ്ഞെടുപ്പ് പ്രചാരണത്തിനിടെ വ്യാജ വീഡിയോകൾ പ്രചരിപ്പിക്കപ്പെട്ടതായും വാർത്തകളുണ്ടായിരുന്നു. ഇന്ത്യയിലെ പ്രശസ്ത അന്വേഷണാത്മക മാധ്യമ പ്രവർത്തക റാണ അയ്യൂബ് ഡീപ്ഫെയ്കിന് ഇരയായിട്ടുണ്ട്. കേന്ദ്ര സർക്കാറിന്റെ അഴിമതിക്കെതിെര എഴുതിയതിന്റെ പേരിൽ ഹിന്ദുത്വ തീവ്രവാദികൾ അവരുടെ വ്യാജ അശ്ലീല വീഡിയോ പ്രചരിപ്പിക്കുകയായിരുന്നു.

തിരഞ്ഞെടുപ്പുകളിൽ അടക്കം ഇവ വലിയ സ്വാധീനം ചെലുത്താൻ സാധ്യതയുണ്ടെന്ന സന്ദേശമാണ് ഈ റിപ്പോർട്ടുകളെല്ലാം നൽകുന്നത്. ഒരാളുടെ പേരിൽ എഴുതി പ്രചരിപ്പിക്കുന്ന കാര്യങ്ങൾ പോലും സത്യമെന്ന് വിശ്വസിക്കപ്പെടുന്ന ഇന്ത്യ പോലുള്ള രാജ്യത്ത് ഡീപ്ഫെയ്കുകൾ കൂടി വന്നാലുള്ള സാമൂഹിക പ്രത്യാഘാതം ഗുരുതരമായിരിക്കുമെന്ന് വിദഗ്ധർ ചൂണ്ടിക്കാട്ടുന്നു. ലോക്സഭാ തിരഞ്ഞെടുപ്പിന്റെ പശ്ചാത്തലത്തിൽ വ്യാജവാർത്തകൾ തടയാൻ കർശന നടപടി വേണമെന്ന് സമൂഹ മാധ്യമങ്ങൾക്ക് ഇന്ത്യ നിർദേശം നൽകിയിട്ടുണ്ടെങ്കിലും ഇത് എത്രമാത്രം ഫലപ്രദമാകുമെന്ന ആശങ്ക ഇപ്പോഴും നിലനിൽക്കുന്നുണ്ട്.

നിർമാണം ലളിതം;

തിരിച്ചറിയാൻ പെടാപാട്

എളുപ്പത്തിൽ നിർമിക്കാമെന്നതാണ് ഡീപ്ഫെയ്ക് വീഡിയോകളുടെ അപകട ഭീഷണി വർധിപ്പിക്കുന്നത്. ഏതാനും സാംപിൾ വീഡിയോകൾ നൽകിയാൽ അതിൽ നിന്നും വ്യാജ വീഡിയോ നിർമിക്കാൻ സാധിക്കുന്ന ആപ്പുകൾ വരെ ഇന്റർനെറ്റിലുണ്ട്. പണം നൽകിയാൽ ആരുടെയും ഡീപ്ഫെയ്ക് വീഡിയോകൾ നിർമിച്ചു നൽകാൻ തയ്യാറുള്ള വെബ്സൈറ്റുകളും റെഡി. കമ്പ്യൂട്ടർ പരിജ്ഞാനമുള്ള ആർക്കും ഡീപ്ഫെയ്ക് വീഡിയോ തയ്യാറാക്കാമെന്ന് വന്നാൽ അതുയർത്തുന്ന അപകടം എത്ര വലുതായിരിക്കുമെന്ന് ഊഹിക്കാവുന്നതേയുള്ളൂ.

ഡീപ്ഫെയ്ക് വീഡിയോകൾ തിരിച്ചറിയാൻ നിലവിലെ സൈബർ ഫോറൻസിക് സംവിധാനങ്ങൾ അപര്യാപ്തമാണെന്ന് സൈബർ സുരക്ഷാ വിദഗ്ധർ ചൂണ്ടിക്കാണിക്കുന്നു. അവിദഗ്ധമായി നിർമിക്കപ്പെടുന്ന ഒരു വ്യാജ വീഡിയോ തിരിച്ചറിയാൽ നഗ്നനേത്രങ്ങൾ കൊണ്ട് സാധിക്കും. എന്നാൽ എ ഐ അൽഗോരിതം ഉപയോഗിച്ച് നിർമിക്കുന്ന വീഡിയോകൾ വ്യാജമാണെന്ന് കണ്ടെത്താൻ അത്ര പെട്ടെന്ന് സാധിക്കില്ല. ഇവ തിരിച്ചറിയാൻ പര്യാപ്തമായ സംവിധാനങ്ങൾ വികസിപ്പിക്കാനുള്ള ശ്രമത്തിലാണ് സൈബർ സുരക്ഷാ ഗവേഷകർ. വ്യാജ വീഡിയോ തടയുന്നതിനുള്ള സംവിധാനം കൊണ്ടുവരാൻ അമേരിക്കയുടെ ഡിഫൻസ് അഡ്വാൻസ്ഡ് റിസർച്ച് പ്രൊജക്ടസ് ഏജൻസി 68 മില്യൺ ഡോളർ ചെലവഴിച്ചതായി റിപ്പോർട്ടുകൾ പറയുന്നു.

ന്യൂയോർക്ക് യൂനിവേഴ്സിറ്റിയിലെ വിദഗ്ധർ ഡീപ് ഫെയ്ക് വീഡിയോ കണ്ടെത്താനുള്ള ഒരു ടൂൾ വികസിപ്പിച്ചിട്ടുണ്ട്. കൃത്രിമമായി സൃഷ്ടിക്കപ്പെടുന്ന കണ്ണുകളുടെ ചലനം തിരിച്ചറിഞ്ഞ് വീഡിയോയുടെ ആധികാരികത ഉറപ്പുവരുത്തുകയാണ് ഈ ടൂൾ ചെയ്യുന്നത്. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് തന്നെയാണ് ഇതിനും ഉപയോഗിക്കുന്നത്. എന്നാൽ തികച്ചും സ്വാഭാവികമായ രീതിയിൽ കണ്ണുകളുടെ ചലനം സൃഷ്ടിക്കാൻ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് വിദഗ്ധർക്ക് സാധിക്കും വരെ മാത്രമേ ഈ ടൂളിന് ആയുസുള്ളൂവെന്ന് ചൂണ്ടിക്കാണിക്കപ്പെടുന്നു. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് പോലുള്ള സങ്കേതങ്ങളെയും അവ ഉയർത്തുന്ന വെല്ലുവിളികളെ കുറിച്ചുമെല്ലാം ജനങ്ങളെ ബോധവത്കരിക്കുകയാണ് ഇത്തരം അപകടങ്ങൾ കുറക്കാനുള്ള മാർഗമന്ന് വിദഗ്ധർ പറയുന്നു. ഇത്തരം വീഡിയോകൾ സൃഷ്ടിക്കുന്നതിനെതിരെ കർശന നിയമ നടപടിയുണ്ടാകണമെന്നും അവർ ആവശ്യപ്പെടുന്നു. പക്ഷേ വീഡിയോ വ്യാജമാണെന്ന് തെളിയിക്കാനായാൽ മാത്രമേ നിയമ നടപടി സ്വീകരിക്കാനാകൂ. അല്ലാത്തപക്ഷം നിയമസംവിധാനങ്ങളെ പോലും ഡീപ്ഫെയ്ക് നോക്കുകുത്തിയാക്കും.

ഭാവി എത്ര അപകടരമാണ് എന്ന മുന്നറിയിപ്പാണ് ഇവയെല്ലാം നൽകുന്നത്. സൈബർ സംവിധാനങ്ങളുടെ മുന്നേറ്റം ലോകത്തിന് മുന്നിൽ അനന്തസാധ്യതകൾ തുറന്നിടുമ്പോൾ തന്നെ ലോകത്തെ തകർക്കാനുള്ള ആയുധവും ഇവയിൽ ഒളിഞ്ഞിരിപ്പുണ്ട്. ഇത് മനസ്സിലാക്കി മുന്നിൽ കാണുന്നതെല്ലാം സത്യമാണെന്ന് കണ്ണടച്ചു വിശ്വസിക്കും മുമ്പ് ഒരു വേള ചിന്താശേഷി പ്രയോജനപ്പെടുത്താൻ നാം ശ്രമിക്കേണ്ടിയിരിക്കുന്നു. ഷെയർ ബട്ടണിൽ വിരലമർത്തും മുമ്പ് ഈ ബോധ്യം നമുക്കുണ്ടായാൽ ഒരു പരിധിവരെ ഇത്തരം അപകടങ്ങളിൽ നിന്ന് രക്ഷപ്പെടാനാകും.

സയ്യിദ് അലി ശിഹാബ്

sayyidshihabo@gmail.com